ЛАССО — это… Что такое ЛАССО?

ЛАССО — ЛАССО, нескл., ср. (исп. lazo). У американских охотников аркан с петлей, затягивающейся вокруг шеи животного при набрасывании. Накинуть лассо на дикую лошадь. Толковый словарь Ушакова. Д.Н. Ушаков. 1935 1940 … Толковый словарь Ушакова

лассо — нескл., ср. lasso <исп. lazo <лат. laqueus петля. Аркан со скользящей петлей для ловли животных. Крысин 1998. Лекс. БАС 1 : лассо/; Крысин: лассо/ … Исторический словарь галлицизмов русского языка

ЛАССО — ЛАССО, нескл., ср. Аркан со скользящей петлёй у конных пастухов и охотников (у нек рых народов). Толковый словарь Ожегова. С.И. Ожегов, Н.Ю. Шведова. 1949 1992 … Толковый словарь Ожегова

лассо — неизм.; ср. [франц. lasso от исп. lazo] Аркан со скользящей петлёй, предназначенный для ловли животных. Бросить л. Полёт л. Прочное л. * * * лассо (франц. lasso, от исп.

лассо — аркан Словарь русских синонимов. лассо сущ., кол во синонимов: 1 • аркан (8) Словарь синонимов ASIS. В.Н. Тришин. 2013 … Словарь синонимов

лассо — (неправильно лассо) … Словарь трудностей произношения и ударения в современном русском языке

лассо — ЛАССО, нескл., ср Охотничье приспособление некоторых народов в виде длинной веревки с нефиксированной петлей на одном конце, используемое для ловли животных. Чукча ловко накинул лассо на голову оленя … Толковый словарь русских существительных

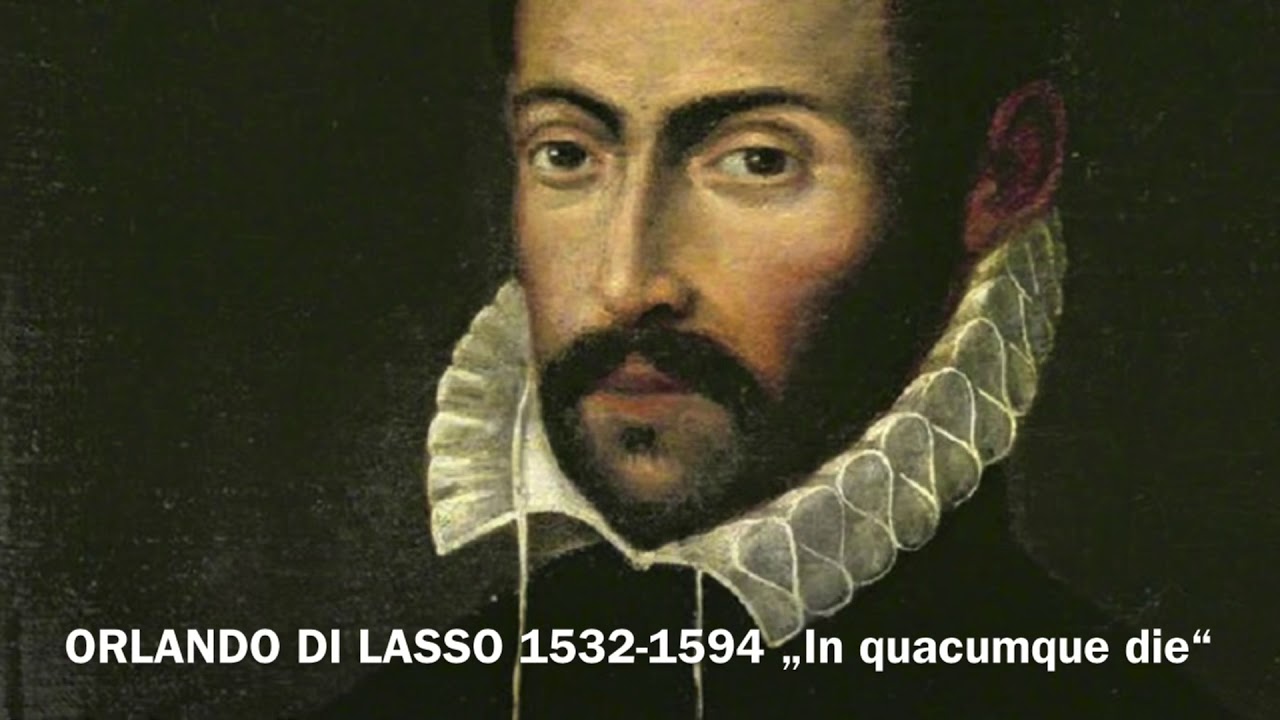

ЛАССО — (Lasso) Орландо (около 1532 94), франко фламандский композитор. Представитель нидерландской школы. Работал во многих городах Европы. Творчески претворил характерные черты нидерландской, немецкой, французской и итальянской музыки. Создал высокие… … Современная энциклопедия

ЛАССО — (франц. lasso от исп. lazo петля), веревка или ремень со скользящей петлей для ловли животных. Употребляется у многих народов Азии и Америки … Большой Энциклопедический словарь

lasso от исп. lazo петля), веревка или ремень со скользящей петлей для ловли животных. Употребляется у многих народов Азии и Америки … Большой Энциклопедический словарь

лассо́ — [не лассо], нескл., с … Русское словесное ударение

Что такое ЛАССО, определение термина в Словарь иностранных слов

ковбойка, ковбой, верёвка, вестерн, петля, канат, ловушка, ловля, капкан, лошадь,

Чарльз Квеннелл, Первобытные люди. Быт, религия, культура

Однако его попытка набросить лассо на одну из кобылиц оказалась безуспешной.

Ольга Гусакова, Хранители веры. О жизни Церкви в советское время, 2014

Короткая скачка наперерез ослу — и гнедой вынес своего хозяина на расстояние, с которого можно было метнутьТомас Майн Рид, Всадник без головы

Спрыгнув с седла, он направился к убитому ослу, чтобы снять с его шеи своё лассо, однако почему-то, едва сделав это, со всех ног кинулся к своей лошади.Томас Майн Рид, Всадник без головы

Словно отвечая на отчаянный призыв, огненная лента обвилась вокруг его другого запястья — ни дать ни взятьДжеймс Роллинс, Джейк Рэнсом и воющий сфинкс, 2011

Кроме того, почти у каждого было длинное ремённое лассо, очень ловко используемое для ловли скота в саваннах.

Л. А. Буссенар, Охотники за каучуком, 1888

Какую-то секунду он постоял в такой позе, а затем медленно, словно раскручивал невидимое лассо, начал водить ею в воздухе.Н. В. Щерба, Часовой ключ, 2011

Свёрнутое лассоМарк Твен, Налегке, 1872

Неожиданно верёвка лассо вылетала из руки ковбоя.

Евгений Петров, Одноэтажная Америка, 1936

Основное искусство ковбоя — вовсе не стрельба, а верховая езда и бросаниеАлексей Цветков, Атлантический дневник (сборник)

А на кораблях будут летать эдакие ковбои с лассо и в сапогах со шпорами.А. И. Первушин, «Небо должно быть нашим!»

Все степняки очень хорошо владели неким подобием

Г. К. Шаргородский, Заблудшая душа. Диверсант, 2013

Он поймал своего мустанга крепким лассо, которое изготовил своими руками, приправляя его мудростью и уроками жизни.Святослав Саражин, Взрослые сказки четвертого измерения. Мотивационные повести (сборник), 2015

Какое-то время рядом с машиной скакали пастухи-гаучо, потом они свернули в сторону, метнув в воздух свои лассо.Эрих Мария Ремарк, Гэм, 1924

Мы сделали этот шаг, и тогда навстречу нам полетели верёвочные лассо и сети.

Александр Шохов, Отец Смерти

Их не ловят на лассо — только на сахар-рафинад.Татьяна Стрельченко, Упаковщица тайн и другие истории

Но он, не останавливаясь, вдруг выбросил лассо, и я оказался на земле с верёвкой на шее.Владимир Дэс, Из рая в рай (сборник)

Длинная петля лассо обхватила обоих пастухов и сбила их с ног.

Н. К. Чуковский, Водители фрегатов, 1941

Воспоминания пробудили горько-сладкое чувство, которое словно лассо обвило её сердце.Барбара Ханней, Сбежавшая из-под венца

Не прошло и часа, как мустангер уже двинулся в путь на своём гнедом, ведя за собой на лассо дикую лошадь.Томас Майн Рид, Всадник без головы

И в это мгновение что-то похожее на лассо опустилось мне на плечи, скользнуло на руки и закрепилось рывком.

Лин Картер, Джандар с Каллисто, 1972

О дороге теперь можно было не беспокоиться — отчётливый след лассо тянулся непрерывной полосой и был хорошо виден.Томас Майн Рид, Всадник без головы

Свищут, как в броске лассо.Георгий Мединцев, Я вам дарю свой стих певучий… (сборник стихов), 2015

Также у них в ходу были лассо и пращи.

Тадеуш Сулимирский, Сарматы. Древний народ юга России, 2010

Действительно, дромадеры особо не сопротивлялись; они расступились с медленной поспешностью, словно смирившись, и приняли укротившие их лассо.Эрик-Эмманюэль Шмитт, Ночь огня, 2015

Те же качества заставляли его беспрекословно садиться на любую лошадь, какую бы ему ни дали, самому напоминать о своей очереди для выезда в ночное и без устали и страха сгонять разбежавшееся стадо закинутым, извивающимся в воздухе лассо. Джек Лондон, Маленькая хозяйка большого дома. Храм гордыни (сборник)

Храм гордыни (сборник)

Макс Брэнд, Улыбка сорвиголовы

Как оно отличается от лёгкого тридцатипятифутового лассо, что используется жителями юго-запада!Макс Брэнд, Улыбка сорвиголовы

Сначала медленно, но затем, словно мир тянул меня к себе невидимым лассо, которым была его притягивающая сила, падение ускорилось и стало довольно быстрым, чтобы разбиться о стремительно приближающуюся твердь.

Сергей Сироткин, Путь. Книга 2, 2015

На прошлой неделе здесь, возле замка, они упражнялись в бросании лассо, так что поблизости где-то должна была валяться верёвка, обязательно должна…Астрид Линдгрен, Калле Блюмквист и Расмус, 1953

Его лассо было готово для броска, и он выбрал рослую пегую, производившую впечатление, что она способна идти лёгким галопом без передышки достаточно долго.Макс Брэнд, Тропа Джексона

Простого хлопка лассо по крупу для хорошо вышколенной лошади, прошедшей на ранчо полный курс обучения, оказалось достаточно, чтобы застыть на месте, ибо она хорошо знала, что любой последующий рывок причинит ей сильнейшую боль от натянутой верёвки.

Макс Брэнд, Тропа Джексона

Лишь тогда ей удалось вырваться из лассо тягостных мыслей, которые крутились в её голове.Тесс Герритсен, Двойник, 2004

Они изготовляли инструмент, посуду, лассо, луки, стрелы, ловушки.Саша Кругосветов, Архипелаг Блуждающих Огней, 2012

Там и сям появлялись всё новые скваттеры; они оседали на земле и без шума приступали к работе со своим лассо и переносными инструментами.

Макс Брэнд, Одиночка Джек

Причём все они смотрели на него, странно ухмыляясь и разматывая верёвки, один уже крутил лассо над головой.В. Г. Поселягин, Гранд-мастер, 2016

Под руководством одного знаменитого старого воина я научился стрелять из лука, владеть томагавком и ружьём, метать лассо, укрощать самого дикого коня; а при случае участвовал в рыболовных и охотничьих экскурсиях индейцев.Фредерик Марриет, Приключения Виоле в Калифорнии и Техасе, 1843

Мы нашли там семь крепких коней, пойманных нашими лассо.

Фредерик Марриет, Приключения Виоле в Калифорнии и Техасе, 1843

При моём появлении весь табун бросился бежать прежде, чем я успел схватиться за лассо, и вдруг к своему изумлению я увидел, что белая лошадь, которую я так долго искал, стоит у какого-то дерева, словно привязанная к нему канатом.Эмилио Сальгари, На Дальнем Западе, 1908

Я наколдовала лассо, которым смогла зацепиться за шею птицы.Р. Иви, Мэрилэнд. Наследница королевства

А её способность бросать лассо и скакать верхом наравне с лучшими из них снискали ей уважение и преданность.

Рэдклифф, Невинные сердца, 2010

Судя по присутствию лассо, которое разматывали два местных ханыги, парня собирались повесить.Миша Лютый-Архангельский, Настоящему индейцу завсегда везде ништяк. Романтика – кислород для души, 2015

На вершине горы верховые ковбои держали наготове свои лассо.Джанни Родари, Путешествие Голубой Стрелы, 1954

Неужели для этого предназначены наши лассо?Джанни Родари, Путешествие Голубой Стрелы, 1954

Пошептались купцы, рассмеялись, вышли на берег, захватив с собой канат и верёвку, на которой сделали петлю и узел, лассо, чтобы было удобнее захватить спящего, затем влезли на утёс, чтобы набросить петлю и втащить человека в золотом вооружении на свой корабль, увезти его к устью египетской реки и продать в рабство.

Г. Р. Хаггард, Скиталец, 1890

Ещё несколько прыжков, и я… перед дверью решётки, широко открытой… Человек, которого я преследую, оборачивается в седле… смеётся и издаёт свист… Он мчится, как стрела… между стволами дубов… Что-то задевает мои уши, обвивается вокруг головы… я в петле… лассо выхватило меня из седла и сбросило на землю с неслыханной силой… Оглушённый этим падением, я, однако, пытался бороться, кричать, защищаться, но не успел.Л. А. Буссенар, Ледяной ад, 1900

Но позвольте мне сделать сначала небольшое замечание. .. человек, набросивший на меня лассо, сделал это с поразительною ловкостью, на какую способны только южные американцы, гаучо или мексиканцы.

.. человек, набросивший на меня лассо, сделал это с поразительною ловкостью, на какую способны только южные американцы, гаучо или мексиканцы.Л. А. Буссенар, Ледяной ад, 1900

Фанаты считали, что персонаж сериала «Тед Лассо» создан при помощи CGI

Персонаж популярного американского сериала «Тед Лассо», который выходит на сервисе Apple TV+, стал причиной теории заговора. Фанаты считают, что он создан при помощи CGI (изображения, сгенерированные компьютером). Впервые схожесть Кента с компьютерным персонажем заметил пользователь Reddit с ником cutterman1234. В ветке форума автор задается вопросом: сошел ли он с ума, или Рой действительно выглядит как персонаж, нарисованный при помощи CGI.

Некоторые пользователи посчитали, что это обычный человек. Однако еще больше людей сошлось на том, что cutterman1234 может быть прав. Часть из них написала, что замечали что-то странное, но не могли понять, что именно. Теперь для них все сошлось – Рой Кент – персонаж, созданный при помощи компьютерной графики.

Часть из них написала, что замечали что-то странное, но не могли понять, что именно. Теперь для них все сошлось – Рой Кент – персонаж, созданный при помощи компьютерной графики.

Благодаря пользователям, которые разместили скриншоты ветки Reddit в социальной сети Twitter, теория заговора вокруг сериала Apple TV+ обзавелась еще большим количеством последователей.

Одна из пользователей Twitter написала: «Официально объявляю конспирологическую теорию CGI Роя Кента открытой», после чего выложила четыре фотографии актера Бретта Голдстина с подписью: «Этот человек кажется вам реальным?».

DOES THIS MAN LOOK REAL TO YOU pic.twitter.com/RlKrqosqOC

— asoingbob »Comms Open» odenkirk (@imnormalnow) July 13, 2021

Несмотря на то, что Голдстин действительно существует, нельзя не признать, что его персонаж действительно вызывает ощущения нереальности. Как пишет The Verge, в заблуждение может вводить идеально выбритый Рой и то, что съемочная команда использует слишком мягкий свет, из-за чего кожа и одежда персонажа кажутся чрезмерно гладкими и блестящими. Издание также отмечает, что его голова кажется больше в сравнении с остальным телом, а его футболки заставляют их думать о компьютерной серии FIFA.

Как пишет The Verge, в заблуждение может вводить идеально выбритый Рой и то, что съемочная команда использует слишком мягкий свет, из-за чего кожа и одежда персонажа кажутся чрезмерно гладкими и блестящими. Издание также отмечает, что его голова кажется больше в сравнении с остальным телом, а его футболки заставляют их думать о компьютерной серии FIFA.

Сам Бретт Голдстин, который еще является автором сценария сериала, вчера иронично прокомментировал теорию, сняв видео в Instagram с наложенной AR-маской Memoji. Актер заявил, что конечно же он настоящий и ежедневно выполняет обычную актерскую работу вроде рендеринга [процесс получения изображения по модели с помощью компьютерной программы — «Газета.Ru»].

Этим видео и использованием фильтра с маской дополненной реальности актер еще больше запутал заговорщиков. Несмотря на существование самого актера и множество ролей в сериалах, конспирологи уверены, что не только Рой является вымышленным персонажем, но и сыгравший его Бретт Голдстин.

Несмотря на существование самого актера и множество ролей в сериалах, конспирологи уверены, что не только Рой является вымышленным персонажем, но и сыгравший его Бретт Голдстин.

Арт-директор по компьютерной графике The Agency of Wargaming Дмитрий Люцко в беседе с «Газетой.Ru» выразил уверенность в том, что роль Роя Кента исполняет самый настоящий человек.

«Сомнения у зрителей могли возникнуть из-за ряда причин: например, агрессивный грим и перебор с постобработкой видео могли внести некоторую искусственность. Да и характер самого персонажа, который воплощает в кадре актер, тоже могли повлиять на восприятие», — считает Люцко.

Эксперт добавил, что разница между CG-моделью [CG — компьютерная графика] и реальным актером на современном этапе развития компьютерной графики видна преимущественно в анимации цифрового персонажа, а именно в мелочах — например, в поведении глазного яблока и век при микродвижениях, при моргании, в сокращениях мышц лица.

«Это до сих пор достаточно тяжело воспроизвести реалистично», — считает Люцко.

Обсуждение реальности Роя Кента стало прецедентом, заявила генеральный директор PGR agency Анастасия Бастрыкина.

«Оно показало, что эпоха оцифрованной реальности окончательно наступила и теперь все чаще люди будут сомневаться — настоящий ли человек перед ними на фото, видео, в кино или это компьютерная графика. Будет интересно наблюдать за развитием этой индустрии и за тем, как она будет саморегулироваться. Возможно, однажды станет неважно, кто цифровой, а кто настоящий, или наоборот — будет принятно в титрах к фильму отдельно отмечать цифровых «актеров». Это покажет время. А пока можно только похвалить Бретта Голдстина за остроумный ответ», — сообщила Бастрыкина.

В современном мире несложно потерять грань между реальной картинкой и созданной при помощи компьютерной графики. Ранее «Газета.Ru» рассказывала о выступлении Дженсена Хуанга, гендиректора Nvidia, на конференции GTC 2021. Как стало известно позже – на видео был не глава компании, а его CGI-двойник. Пока об этом не объявила Nvidia, никто даже не мог предположить, что это был человек, который полностью воссоздан при помощи компьютерной графики.

Что такое Лассо? Значение слова Лассо

Поделитесь с друзьями значением слова — «Лассо». Расскажите об этом на своей странице!

Определение слова Лассо по Ефремовой

Лассо — Аркан со скользящей петлей, предназначенный для ловли животных.

Один из элементов обязательной программы (в парном фигурном катании).

Определение слова Лассо по Ожегову

Лассо — Аркан со скользящей петлей у конных пастухов и охотников (у некоторых народов)

Лассо — описание в Энциклопедическом словаре

Лассо — (Lasso) Орландо (ок. 1532-94) — франко-фламандский композитор.Представитель нидерландской школы. Работал во многих европейских странах.Обобщил и новаторски развил достижения различных европейских музыкальныхшкол эпохи Возрождения. Мастер культовой и светской хоровой музыки (св.2000 сочинений.).

(франц. lasso — от исп. lazo — петля), веревка или ремень соскользящей петлей для ловли животных. Употребляется у многих народов Азиии Америки.

Определение слова Лассо по словарю Ушакова

ЛАССО

нескл., ср. (исп. lazo). У американских охотников — аркан с петлей, затягивающейся вокруг шеи животного при набрасывании. Накинуть лассо на дикую лошадь.

Значение слова «Лассо» по БСЭ

Лассо — Лассус (Lasso, Lassus) Орландо (настоящее имя и фамилия — Ролан де Ласею, Roland de Lassus) (около 1532, Мопс, — 14.6.1594, Мюнхен), франко-фламандский композитор. Крупнейший представитель нидерландской школы, один из величайших мастеров полифонии. В детстве пел в церковном хоре в Монсе. Находясь на службе у герцога Фердинанда Гонзаги (с 1544), побывал в Сицилии, Италии, Франции и Англии. С 1556 жил в Мюнхене, где пел в придворной капелле, в 1563-94 руководил ею. Завоевал европейскую известность. Типичный представитель эпохи Возрождения, объединивший в творчестве особенности разных национальных музыкальных культур, Л. создал высокие образцы хоровой полифонии различных жанров светской и культовой музыки. Образный мир его музыки широк и разнообразен — от глубокой скорби до юмора, от философской углублённости до грубоватой жанрово-бытовой сценки, от бурных драматических страстей до тонкой душевной лирики. В большинстве произведений (всего создал свыше 2000) Л. опирался на народную песенность. Среди культовых сочинений выделяются Мотеты (всего создал свыше 1200. сборник 516 мотетов под названием «Великое музыкальное творение», издан посмертно в Монако, 1604),

Образный мир его музыки широк и разнообразен — от глубокой скорби до юмора, от философской углублённости до грубоватой жанрово-бытовой сценки, от бурных драматических страстей до тонкой душевной лирики. В большинстве произведений (всего создал свыше 2000) Л. опирался на народную песенность. Среди культовых сочинений выделяются Мотеты (всего создал свыше 1200. сборник 516 мотетов под названием «Великое музыкальное творение», издан посмертно в Монако, 1604),

«Покаянные псалмы» (1565) и мессы (57 месс, большей частью а капелла). Хоровое и оркестровое звучание монументальных полифонических произведений Л. отличается красочностью, пышностью, сочностью, драматической силой. В светских сочинениях — итальянских мадригалах, французских и немецких многоголосных песнях и др. вокальных произведениях на тексты античных и современных Л. поэтов, а также на свои собственные стихи (среди них — получившая мировую известность песня «Эхо», исполняемая и сов. хорами)

— часто использовал бытовые интонации, юмор, изобразительные эффекты, придающие этим сочинениям характер нидерландской «жанровости». Создал свою школу (крупнейший из учеников — Дж. Габриели).

Создал свою школу (крупнейший из учеников — Дж. Габриели).

Лит.: Булычев В. (Иванов-Борецкий М. В.), Орландо Лассо. Биографический очерк, М., 1908. Boetticher W., Orando di Lasso und seine Zeit, Kassel — Basel, 1958.

Б. В. Левик.

О. Лассо.

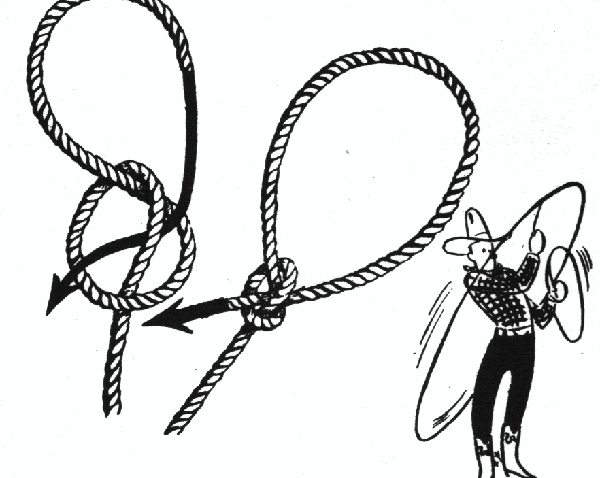

Лассо — Лассо (франц. lasso, от исп. lazo — петля)

длинный (от 15 до 30 м) аркан со скользящей петлей, сплетённый из ремней, конского волоса или шерсти. Л., видимо, возникло как охотничья снасть, а затем получило распространение у скотоводов. Было известно в странах Древнего Востока, у скифов. под различными названиями употреблялось и употребляется многими народами Азии. С завозом в Америку лошадей и рогатого скота Л. сделалось распространённой снастью у некоторых индейских племён, занимавшихся конной охотой.

Не удается найти страницу | Autodesk Knowledge Network

(* {{l10n_strings.REQUIRED_FIELD}})

{{l10n_strings.CREATE_NEW_COLLECTION}}*

{{l10n_strings. ADD_COLLECTION_DESCRIPTION}}

ADD_COLLECTION_DESCRIPTION}}

{{l10n_strings.DRAG_TEXT_HELP}}

{{l10n_strings.LANGUAGE}} {{$select.selected.display}}{{article. content_lang.display}}

content_lang.display}}

{{l10n_strings.AUTHOR_TOOLTIP_TEXT}}

{{$select.selected.display}} {{l10n_strings.CREATE_AND_ADD_TO_COLLECTION_MODAL_BUTTON}} {{l10n_strings.CREATE_A_COLLECTION_ERROR}}Рецензия на спортивный комедийный сериал Ted Lasso / «Тед Лассо»

Большинство рецензий на сериал Ted Lasso / «Тед Лассо» от Apple TV+, которые вы найдете в Сети, начинаются с фразы «Вы должны немедленно посмотреть этот сериал!». И как бы ни хотелось мне быть оригинальным, боюсь, придется использовать практически те же слова. Ted Lasso – это сериал, который вы обязаны посмотреть, может быть, хотя бы он поможет вам смириться со всеми проблемами этого непростого года.

И как бы ни хотелось мне быть оригинальным, боюсь, придется использовать практически те же слова. Ted Lasso – это сериал, который вы обязаны посмотреть, может быть, хотя бы он поможет вам смириться со всеми проблемами этого непростого года.

Жанр комедия, спорт

Создатели Билл Лоуренс, Джейсон Судейкис

В ролях Джейсон Судейкис (Тед Лассо), Ханна Уэддингем (Ребекка Уэлтон), Брендан Хант — (тренер Борода), Джереми Свифт (Лесли Хиггин), Бретт Голдстейн (Рой Кент), Фил Данстер (Джейми Тартт), Ник Мохаммед (Нейт), Джуно Темпл (Кили Джонс) и др.

Канал Apple TV+

Год выпуска 2020

Серий 10

Сайты IMDb

Тед Лассо – тренер команды Студенческой лиги США по американском футболу (а вы знали, что правильно Gridiron football, хотя можно и North American football?), которого приглашают тренировать команду английской Премьер-лиги по нормальному футболу. Да-да, мы отлично знаем, что такое в принципе невозможно, без соответствующей лицензии в Великобритании его не допустят даже школьников тренировать, но успокойтесь, это все-таки кино, более того, комедия. Зачем это нужно владельцам клуба, станет ясно уже в конце первой серии, зачем в это ввязался Тед – где-то в середине сезона. Тед Лассо берется за дело, не зная даже базовых правил футбола, мало того, его помощники – тренер по шахматам и запуганный китмен (подсобный работник, отвечающий за форму игроков и дополнительное оборудование). Но невероятный оптимизм, умение находить общий язык с людьми, мотивировать и направлять их, помогает Лассо завоевать авторитет у игроков, руководства команды, журналистов и даже болельщиков, несмотря на весьма посредственные результаты, которые показывает его команда.

Да-да, мы отлично знаем, что такое в принципе невозможно, без соответствующей лицензии в Великобритании его не допустят даже школьников тренировать, но успокойтесь, это все-таки кино, более того, комедия. Зачем это нужно владельцам клуба, станет ясно уже в конце первой серии, зачем в это ввязался Тед – где-то в середине сезона. Тед Лассо берется за дело, не зная даже базовых правил футбола, мало того, его помощники – тренер по шахматам и запуганный китмен (подсобный работник, отвечающий за форму игроков и дополнительное оборудование). Но невероятный оптимизм, умение находить общий язык с людьми, мотивировать и направлять их, помогает Лассо завоевать авторитет у игроков, руководства команды, журналистов и даже болельщиков, несмотря на весьма посредственные результаты, которые показывает его команда.

Жизнерадостность Теда Лассо и его способность в любой ситуации видеть только светлую сторону поначалу не на шутку раздражают. Это тот самый хваленый американский оптимизм, возведенный в абсолют и умноженный на 100. Постоянно улыбающийся, сыплющий каламбурами и приветливый даже тогда, когда над ним откровенно издеваются, Тед Лассо кажется нелепым болваном, идеальным козлом отпущения, на которого можно будет списать все проблемы клуба. Но невероятный оптимизм тренера, за которым, как мы узнаем позже, прячется боль, поможет растопить лед, и уже к концу второй серии вы буквально влюбитесь в Теда Лассо, тренера Бороду, напоказ суровую руководительницу клуба Ребекку, в легкомысленную (это, конечно же, не так) Кили, застенчивого Нейта, трусливого Хиггина, брутального Роя Кента и даже в эгоистичного Джейми Тартта.

Постоянно улыбающийся, сыплющий каламбурами и приветливый даже тогда, когда над ним откровенно издеваются, Тед Лассо кажется нелепым болваном, идеальным козлом отпущения, на которого можно будет списать все проблемы клуба. Но невероятный оптимизм тренера, за которым, как мы узнаем позже, прячется боль, поможет растопить лед, и уже к концу второй серии вы буквально влюбитесь в Теда Лассо, тренера Бороду, напоказ суровую руководительницу клуба Ребекку, в легкомысленную (это, конечно же, не так) Кили, застенчивого Нейта, трусливого Хиггина, брутального Роя Кента и даже в эгоистичного Джейми Тартта.

Большинство персонажей в Ted Lasso очень легко читаются и выглядят даже примитивными, но это не так, каждый из них совсем не тот, кем кажется на первый взгляд. Кили умнее и глубже, чем вы думаете; Ребекка совсем не злая, просто так она переживает боль; Нейт видит то, что не замечают другие; Рой может переступить через себя, если это нужно для клуба; и даже разрушающий команду Джейми Тартт не так однозначно отвратителен, как вы думаете вначале. Заслуга Теда Лассо в том, что он умеет под слоем брони рассмотреть человека, который там прячется, и вывести его наружу. А еще Теда всегда недооценивают, и пусть он не знает, что такое угловой или оффсайд, зато он знает, как заставить людей поверить в себя и выложиться на все сто.

Заслуга Теда Лассо в том, что он умеет под слоем брони рассмотреть человека, который там прячется, и вывести его наружу. А еще Теда всегда недооценивают, и пусть он не знает, что такое угловой или оффсайд, зато он знает, как заставить людей поверить в себя и выложиться на все сто.

Вообще, складывается впечатление, что Ted Lasso / «Тед Лассо» – это адаптированная игровая версия какого-то спокона, аниме на спортивную тематику, столь популярного в Японии. Например, Captain Tsubasa или Haikyu!!. Зачастую в аниме этого жанра команда-аутсайдер в каком-либо виде спорта, превозмогая трудности, решая проблемы взаимодействия и повышая мотивацию, добивается победы в решающем поединке над принципиальными противниками. Что ж, Ted Lasso скроен именно по таким лекалам. Не вижу в этом ничего плохого.

Одним из создателей сериала является Джейсон Судейкис, сыгравший в нем главную роль. Комик-импровизатор, постоянный участник и сценарист шоу Saturday Night Live, он может быть знаком вам по фильмам Horrible Bosses, We’re the Millers. Собственно, идея сериала восходит к старым скетчам Судейкиса, для которых он придумал тренера Лассо, в шутливой форме объясняющего американцам правила европейского футбола. Что ж, теперь Судейкиса будут вспоминать исключительно как Теда Лассо, таким запоминающимся и ярким получился этот персонаж в полнометражном сериале. Настолько ярким, что Apple продлила Ted Lasso на второй сезон через пять дней после премьеры. И это при том, что никакого клиффхангера в финале нет, это вполне законченная история, хотя и оставляющая пространство для продолжения.

Собственно, идея сериала восходит к старым скетчам Судейкиса, для которых он придумал тренера Лассо, в шутливой форме объясняющего американцам правила европейского футбола. Что ж, теперь Судейкиса будут вспоминать исключительно как Теда Лассо, таким запоминающимся и ярким получился этот персонаж в полнометражном сериале. Настолько ярким, что Apple продлила Ted Lasso на второй сезон через пять дней после премьеры. И это при том, что никакого клиффхангера в финале нет, это вполне законченная история, хотя и оставляющая пространство для продолжения.

По большому счету, единственная серьезная проблема Ted Lasso, кроме невероятной предсказуемости (что поделать, законы жанра неумолимы) – это перевод. Дело в том, что многие шутки и каламбуры в сериале основаны на различиях американского и британского английского. Естественно, в переводе они в лучшем случае пропадают, в худшем звучат просто глупо. Так что в очередной раз рекомендуем смотреть сериал с оригинальной дорожкой и субтитрами.

В первом сезоне Ted Lasso / «Тед Лассо» всего десять серий, и теперь, когда они собрались вместе (сериал выкладывали на Apple TV+ с середины августа до начала октября по одной серии) их легко проглотить буквально за один день. Очень уж легко он смотрится. Не делайте подобной ошибки, растяните его хотя бы на пару дней, это позволит продлить терапевтический эффект. Ведь этот сериал действительно заряжает зрителей позитивной энергией и оптимизмом. Ted Lasso, пожалуй, лучшее, что случилось с нами в 2020 г. Не пропустите.

Плюсы: Невероятный заряд бодрости и оптимизма, которые излучают герои сериала; действительно неплохой юмор; обыгрывание культурных и языковых различий США и Великобритании; совсем не одномерные персонажи

Минусы: При переводе многие шутки теряют соль; предсказуемый сюжет

Вывод: Самый добрый и оптимистичный сериал 2020 г.

«Тед Лассо» – комедия про футбол, которая заставит вас умиляться и научит верить в себя не хуже, чем любая спортивная драма.

Apple TV+ часто становится отличной темой для шуток среди людей, которые любят смотреть сериалы. Во-первых, Apple погрузились в производство собственного видеоконтента уже тогда, когда свой стриминговый сервис имели плюс-минус все уважающие себя корпорации. А во-вторых, за два года существования проекта достойные оригинальные сериалы на нем можно сосчитать по пальцам одной руки. Но вы о них, скорее всего, и так уже слышали: это «Утреннее шоу» с Дженнифер Энистон и Стивом Кареллом, «Защищая Джейкоба» с Крисом Эвансом и «Видеть» с Джейсоном Момоа. Как несложно догадаться, внимание к себе сериалы Apple TV+ привлекают в основном из-за звездных актеров в главных ролях.

В остальном о новых проектах сервиса говорить как-то не принято. Мало кто в таких конкурентных условиях всерьез обратит внимание на Apple TV+. Тем более на наполнение платформы контентом нужны время и деньги (их, правда, у Apple хватает). И все-таки мы решили продолжить изучение сервиса даже после того, как посмотрели на нем все хитовые проекты. Наш выбор пал на сериал «Тед Лассо», премьера которого состоялась этим летом. Рассказываем о том, что это такое и чем может вам понравиться.

Тем более на наполнение платформы контентом нужны время и деньги (их, правда, у Apple хватает). И все-таки мы решили продолжить изучение сервиса даже после того, как посмотрели на нем все хитовые проекты. Наш выбор пал на сериал «Тед Лассо», премьера которого состоялась этим летом. Рассказываем о том, что это такое и чем может вам понравиться.

«Тед Лассо» – идея комика Джейсона Судейкиса, который сам и исполняет главную роль тренера футбольного клуба «Ричмонд». Также соавтором проекта числится создатель «Клиники» Билл Лоуренс. А он уж точно знает толк в телевизионных комедийных сериалах. Но «Тед Лассо», вопреки ожиданиям, максимально не похож на «Клинику». Может быть, только тем, что тут также находится место и комедийным, и драматическим моментам.

Концепция примерно такая: главный тренер команды по американскому футболу из Штатов становится звездой интернета после того, как видео с его искренним празднованием победы попадает в сеть. Из-за этого его замечают в Великобритании и приглашают на роль наставника команды футбольной Премьер-лиги. Если вы еще не поняли, в чем подвох, объясняем: «футбол» в США и в Англии – это два разных вида спорта. Так что Теду Лассо приходится стать тренером команды в игре, о которой он ничего не знает. Казалось бы, зачем кому-то вообще ставить тренером человека, ничего не понимающего в футболе? Но так как это ситуационная комедия, здесь все очень удачно совпадает и обыгрывается. По ходу просмотра вы обязательно все поймете.

Из-за этого его замечают в Великобритании и приглашают на роль наставника команды футбольной Премьер-лиги. Если вы еще не поняли, в чем подвох, объясняем: «футбол» в США и в Англии – это два разных вида спорта. Так что Теду Лассо приходится стать тренером команды в игре, о которой он ничего не знает. Казалось бы, зачем кому-то вообще ставить тренером человека, ничего не понимающего в футболе? Но так как это ситуационная комедия, здесь все очень удачно совпадает и обыгрывается. По ходу просмотра вы обязательно все поймете.

Сперва может показаться, что это сериал про футбол для болельщиков, ведь слишком уж в основной идее преобладает спортивная тематика. На самом деле, «Тед Лассо» может понравиться даже тем, кто о футболе вообще ничего не знает (к тому же сериал создавался американцами в первую очередь для своего рынка, так что ничего удивительного). Но у болельщиков при просмотре, конечно, будет небольшое преимущество: они поймут отсылки в именах героев (например, имя сурового и опытного капитана Роя Кента, судя по всему, вдохновлено игроком Роем Кином), посмеются над шутками на тему разницы в правилах двух видов спорта и прочувствуют всю иронию вокруг выдуманного футбольного клуба «Ричмонд», проводящего свой первый сезон в Английской премьер-лиге.

Но больше всего болельщиков подкупит высмеивание футбольных архетипов. Строгий капитан на закате карьеры, который выиграл все, но теперь играет в клубе второго эшелона, молодой выскочка, арендованный из «Манчестер Сити», который чтит себя легендой футбола и не считается с партнерами, а также бывшая жена владельца клуба, отсудившая у него бизнес, и аргентинский нападающий, который очень любит свою работу и не упускает возможности крикнуть, что футбол – это жизнь.

Несмотря на юмористичность, комедийные образы здесь так или иначе пропитаны драмой. О главном герое мы поговорим чуть позже, но сейчас скажем пару слов об остальных персонажах. Злая бывшая жена, которая хочет напакостить своему экс-супругу, тут в то же время и жертва, которую всю жизнь ставили на второй план и не давали реализовываться. Жена футболиста – девушка, застрявшая в образе гламурной дивы, которая хочет его перерасти и сделать что-то большее в своей жизни. А уборщик с тактическими способностями – неуверенный в себе объект травли и насмешек. Всем этим персонажам и помогает стать лучше Тед Лассо.

О главном герое мы поговорим чуть позже, но сейчас скажем пару слов об остальных персонажах. Злая бывшая жена, которая хочет напакостить своему экс-супругу, тут в то же время и жертва, которую всю жизнь ставили на второй план и не давали реализовываться. Жена футболиста – девушка, застрявшая в образе гламурной дивы, которая хочет его перерасти и сделать что-то большее в своей жизни. А уборщик с тактическими способностями – неуверенный в себе объект травли и насмешек. Всем этим персонажам и помогает стать лучше Тед Лассо.

И вот мы переходим к тому, чем этот сериал нас зацепил. Он невероятно добрый. Но что важно, не перегибает планку и не становится приторным. Вся эта доброта выглядит органично и убедительно. Скорее всего, это заслуга Джейсона Судейкиса. Его герой – не от мира сего. Тед Лассо не принимает каких-то общепринятых социальных норм и руководствуется чувствами. Он вежлив, добр, спокоен. Поначалу может показаться, что герой «мягкий и пушистый», но от этого чувства избавляешься, когда он начинает кричать на подопечных или борется с серьезной панической атакой. Этот момент нам вообще показался самым эмоциональным в сериале: Тед оказывается в другой стране, у него семейные проблемы, недопонимание на работе, это все и вызывает приступ. В такой момент в голове невольно появляется мысль вроде: «Даже таких позитивных людей наш мир может сломать».

Этот момент нам вообще показался самым эмоциональным в сериале: Тед оказывается в другой стране, у него семейные проблемы, недопонимание на работе, это все и вызывает приступ. В такой момент в голове невольно появляется мысль вроде: «Даже таких позитивных людей наш мир может сломать».

Но Тед Лассо не ломается, а становится сильнее, мотивируя этим зрителей. Казалось бы, очень банальный посыл, который мы видели в каждой первой спортивной драме, но это почему-то работает. Просто «Тед Лассо» вышел в очень подходящий момент, и именно этим он подкупил зрителей. Пока одни люди готовились ко второй волне пандемии, а другие пытались привести в порядок свой бизнес, главный герой сериала от Apple научил смотреть на вещи позитивно и не отчаиваться из-за неудач. Для него победы и поражения не имеют значения, лишь бы в команде (или любом другом сообществе) царило взаимопонимание. И Лассо действительно делает героев вокруг себя лучше. К сожалению, в жизни такие утопичные персонажи часто становятся изгоями, но хотя бы в сериале им удается менять мир вокруг себя. И это мотивирует лучше, чем многие спортивные драмы.

И это мотивирует лучше, чем многие спортивные драмы.

Сначала казалось, что в элементах спортивной драмы и кроется главный недостаток сериала. По сути, мы все это уже видели, и не один раз. Тренер-неудачник, которого сначала недолюбливают в команде, а потом приходит результат и любовь публики. Никакой интриги в сериале не было: зритель изначально понимал, к чему все ведет, но сам процесс все равно заставлял проникнуться. Но потом вышли финальные эпизоды, которые чуть ли не вырвали наши сердца.

Ну и, в конце концов, это комедия, а значит, юмор тут все-таки на первом месте. Этим «Тед Лассо» и отличается от многих пафосных спортивных драм. Конечно, вы не будете валяться в истерическом хохоте, но с улыбкой на лице во время просмотра гарантированно просидите.

Также вас может оттолкнуть нереалистичность и гиперболизированность образов в сериале. Но на самом деле в них нет серьезных нелогичностей, здесь просто очень много условностей, которые абсолютно нормально воспринимаются в рамках ситкома. Мы же всерьез не возмущаемся тому, что Джоуи из «Друзей» слишком глупый, а Шелдон из «Теории большого взрыва» чересчур умный и занудный. Так что если с телевизионными комедиями вы в хороших отношениях, то и эта покажется вам отличной.

Мы же всерьез не возмущаемся тому, что Джоуи из «Друзей» слишком глупый, а Шелдон из «Теории большого взрыва» чересчур умный и занудный. Так что если с телевизионными комедиями вы в хороших отношениях, то и эта покажется вам отличной.

Вероятно, вам также будет интересно:

Джейсон Судейкис – о стиле, усах и оптимизме Теда Лассо

Страница лассо

Страница лассоСтраница лассо Подгонка с ограничением L1 |

Лассо — это метод сжатия и выбора для линейной регрессии. Он сводит к минимуму обычную сумму квадратов ошибок с ограничением суммы абсолютные значения коэффициентов. Он связан с мягким пороговым значением вейвлет-коэффициентов, прямой поэтапной регрессии и методов повышения.

Простое объяснение лассо и регрессии по наименьшему углу

Лассо ресурсы и ссылки

- Оригинальная бумага для лассо:

Тибширани Р.

(1996). Регрессионное сжатие и выбор с помощью лассо.

J. Royal. Статист. Soc B., Vol. 58, No. 1, pages 267-288).

(1996). Регрессионное сжатие и выбор с помощью лассо.

J. Royal. Статист. Soc B., Vol. 58, No. 1, pages 267-288). - Глобальная согласованная фильтрация в инженерии:

J.J. Fuchs. О применении глобального согласованного фильтра к оценке DOA с помощью однородных круговых массивов. IEEE Trans, S.П., т.49, с.702—709, апр. 2001 г.

- Алгоритм наименьшего угла регрессии (LAR) для решения лассо:

Эфрон Б., Джонстон И., Хасти Т. и Тибширани Р. (2002). Наименьшая угловая регрессия pdf файл. Опубликовано в Annals of Statistics 2003

Программное обеспечение LARS для Splus и R. Программное обеспечение полностью вычисляет LAR, Lasso или Поэтапный путь в том же порядке вычислений, что и метод наименьших квадратов.

Пакет glmnet для подгонки моделей лассо и эластичной сетки можно найти на КРАН.Вот версия MATLAB.

- L1-ограничения для неортогональных вейвлет-разложений:

Чен, Донохо и Сондерс: «Атомное разложение по основанию (файл ps)» (pdf)

- Анализ выживаемости: Тибширани Р.

(1997). Метод лассо для выбора переменных в модели Кокса.

Статистика в медицине 1998 г.

(1997). Метод лассо для выбора переменных в модели Кокса.

Статистика в медицине 1998 г. - М. Осборн, Б. Преснелл и Б. Турлах: Исследования и программное обеспечение для лассо: Их страница в Univ. Западной Австралии

- Алгоритмы (метод «Стрельба») Вэньцзян Фу (1998).Штрафные регрессии: мост против лассо. JCGS vol 7, no. 3, 397-416.

- Асимптотика: Кит Найт и Вэньцзян Фу (2000). Асимптотика оценок типа лассо Анна. Статист. 28, вып. 5, 1356–1378

- Книги с описанием лассо: Элементы

Статистическое обучение: анализ данных

, вывод и прогнозирование (Хасти, Тибширани, Фридман)Выбор подмножества в регрессии (Миллер)

5.4 — Лассо | STAT 508

Решение гребня может быть трудно интерпретировать, потому что оно не является разреженным (никакие \ (\ beta \) не установлены точно в 0).p | \ beta_j |

Это небольшое, но важное изменение. Некоторые коэффициенты могут быть уменьшены до нуля. Если, например, \ (c = c_0 / 2 \), средняя усадка коэффициентов наименьших квадратов составляет 50%. Если \ (\ lambda \) достаточно велико, некоторые коэффициенты обнуляются, что приводит к разреженной модели . Лассо выполняет сжатие \ (L1 \), так что в ограничении есть «углы», которые в двух измерениях соответствуют ромбу.Если сумма квадратов «попадает» в один из этих углов, то коэффициент, соответствующий оси, уменьшается до нуля. Посмотреть видео Пояснение По мере увеличения \ (p \) многомерный ромб имеет увеличивающееся количество углов, поэтому весьма вероятно, что некоторые коэффициенты будут установлены равными нулю. В отличие от выбора подмножества, Lasso выполняет мягкую пороговую обработку : при изменении параметра сглаживания путь выборки оценок непрерывно перемещается к нулю.q \) можно рассматривать для \ (q \ geq0 \). Риджевая регрессия и лассо соответствуют \ (q = 2 \) и \ (q = 1 \) соответственно. Когда \ (X_j \) слабо связано с \ (Y \), лассо притягивает \ (\ beta_j \) к нулю быстрее, чем регрессия гребня. Обычное лассо не учитывает неопределенность оценки параметров; стандартные ошибки для \ (\ beta \) недоступны сразу. Для вывода с использованием оценщика лассо были предложены различные оценщики стандартной ошибки: Тибширани (1996) предложил бутстрап (Efron, 1979) для оценки стандартных ошибок и получил приблизительную оценку в закрытой форме. Фан и Ли (2001) вывели формулу сэндвича в настройке правдоподобия как средство оценки ковариации оценок. Однако приведенные выше приблизительные ковариационные матрицы дают оценочную дисперсию \ (0 \) для предикторов с \ (\ hat {\ beta} _j = 0 \). «Байесовское лассо» Парка и Каселлы (2008) дает допустимые стандартные ошибки для \ (\ beta \) и обеспечивает более стабильные точечные оценки с использованием апостериорной медианы. Оценка лассо эквивалентна режиму апостериорного распределения при нормальном правдоподобии и независимом априорном режиме Лапласа (двойная экспонента): Цветные линии — это пути уменьшения коэффициентов регрессии к нулю. Если мы проведем вертикальную линию на рисунке, это даст набор коэффициентов регрессии, соответствующих фиксированному \ (\ lambda \). Регрессия по гребню уменьшает все коэффициенты регрессии до нуля; лассо имеет тенденцию давать набор нулевых коэффициентов регрессии и приводит к разреженному решению. Обратите внимание, что как для регрессии гребня, так и для лассо коэффициенты регрессии могут изменяться от положительных до отрицательных значений по мере их уменьшения до нуля. В некоторых контекстах мы можем рассматривать набор регрессоров как группу, например, когда у нас есть категориальная ковариата с более чем двумя уровнями. Сгруппированный лассо Юань и Линь (2007) решает эту проблему, рассматривая одновременное сокращение (заранее определенных) групп коэффициентов. Линейная регрессия и логистическая регрессия — два часто используемых термина, когда мы говорим о регрессии. Полная форма LASSO — операция наименьшей абсолютной усадки и выбора.Как следует из названия, LASSO использует технику «усадки», при которой определяются коэффициенты, которые сужаются к центральной точке в качестве среднего. Регрессия LASSO в регуляризации основана на простых моделях с меньшим количеством параметров. Мы получаем лучшую интерпретацию моделей за счет процесса усадки. Процесс сжатия также позволяет идентифицировать переменные, тесно связанные с переменными, соответствующими цели. Регуляризация решает проблему переобучения, которая влияет на уровень точности модели.Регуляризация выполняется путем добавления члена «штрафа» к уравнению наилучшего соответствия, полученному на основе обученных данных. Этот метод можно эффективно использовать для минимизации количества переменных, поддерживающих их в модели. Регуляризация может служить для различных целей, например для понимания более простых моделей, которые включают модели разреженной и групповой структуры. Есть два важных метода регуляризации: Ридж-регрессия и Лассо-регрессионная модель.Оба метода используются для уменьшения сложности модели. Регрессия лассо также называется методом штрафной регрессии. Этот метод обычно используется в машинном обучении для выбора подмножества переменных. Он обеспечивает большую точность прогнозирования по сравнению с другими регрессионными моделями.Регуляризация лассо помогает улучшить интерпретацию модели. Менее важные характеристики набора данных наказываются регрессией лассо. Коэффициенты этого набора данных обнуляются, что приводит к их исключению. Набор данных с высокой размерностью и корреляцией хорошо подходит для регрессии лассо. D = Остаточная сумма квадратов или наименьших квадратов Лямбда * Совокупность абсолютных значений коэффициентов Лямбда обозначает величину усадки в уравнении регрессии лассо. Лучшая модель выбирается таким образом, чтобы минимизировать наименьшие квадраты. Штрафной коэффициент добавлен для формирования регрессии лассо по методу наименьших квадратов. Выбор модели зависит от ее способности уменьшить указанную выше функцию потерь до минимального значения. Все оцененные параметры присутствуют в штрафах за регрессию лассо, а значение лямбда находится между нулем и бесконечностью, что определяет эффективность агрессивной регуляризации. Лямбда выбирается с помощью перекрестной проверки. Коэффициенты имеют тенденцию к уменьшению и постепенно становятся равными нулю при увеличении значения лямбды. Лассо-регрессия и хребтовая регрессия используются для уменьшения сложности модели. Регрессия гребня также известна как регуляризация L2. Но давайте поймем разницу между регрессией по гребню и лассо: Регрессия хребта имеет небольшой уровень систематической ошибки для получения долгосрочных прогнозов. Как обсуждалось ранее, штрафной член в регрессии лассо содержит абсолютные веса. Следовательно, из-за использования абсолютных значений лассо может сжиматься по направлению к наклону по сравнению с регрессией гребня, которая сжимается почти до нуля. Линейная регрессия Лассо, также известная как Регуляризация L1, сохраняет одну переменную, тогда как другие коррелированные переменные устанавливаются равными нулю.Это приводит к снижению точности из-за потери информации. Риджевую регрессию можно во многом назвать примером регрессии Лассо. Таким образом, можно понять, что у лассо, а также у гребневой регрессии есть свои преимущества. Лассо устраняет коэффициенты (сжимается до нуля) с помощью автоматического выбора переменных для моделей, тогда как Ридж не может этого сделать. Однако оба метода позволяют избежать переобучения, которое присутствует в реалистичных статистических моделях. Регрессия — это хорошо известный метод переобучения. Эти методы помогают в машинном обучении прогнозировать вывод данных. Алгоритм регрессии лассо определяется как алгоритм регуляризации, который помогает исключить нерелевантные параметры, тем самым помогая сконцентрировать выбор и упорядочивая модели.Модели лассо можно оценивать с помощью различных показателей, таких как RMSE и R-Square. Модель Lasso также состоит из Alpha, которая является гиперпараметром. Это можно настроить с помощью Lasso CV для управления регуляризацией. Не существует правильных или неправильных способов изучения технологий искусственного интеллекта и машинного обучения — чем больше, тем лучше! Эти ценные ресурсы могут стать отправной точкой в вашем путешествии по изучению искусственного интеллекта и машинного обучения. Регрессия Лассо: Функция стоимости для регрессии Лассо (оператор наименьшего абсолютного сжатия и выбора) может быть записана как Как и функция стоимости регрессии Риджа, для лямбда = 0 приведенное выше уравнение сводится к уравнению 1.2. Единственная разница в том, что вместо квадрата коэффициентов учитываются величины. Этот тип регуляризации (L1) может привести к нулевым коэффициентам, т.е. некоторые функции полностью игнорируются при оценке результатов. Итак, регрессия Лассо не только помогает уменьшить чрезмерную подгонку, но и может помочь нам в выборе функций. Код, который я использовал для построения этих графиков, выглядит следующим образом: plt.xlabel ('Coefficient Index', fontsize = 16) вкратце. Последнее обновление 6 октября 2021 г. Регрессия — это задача моделирования, которая включает в себя прогнозирование числового значения на основе входных данных. Линейная регрессия — это стандартный алгоритм регрессии, который предполагает линейную связь между входными данными и целевой переменной.Расширение линейной регрессии вызывает добавление штрафов к функции потерь во время обучения, что поощряет более простые модели с меньшими значениями коэффициентов. Эти расширения называются регуляризованной линейной регрессией или штрафной линейной регрессией. Лассо-регрессия — это популярный тип регуляризованной линейной регрессии, который включает штраф L1. Это приводит к уменьшению коэффициентов для тех входных переменных, которые не вносят большой вклад в задачу прогнозирования.Этот штраф позволяет некоторым значениям коэффициентов перейти к нулевому значению, что позволяет эффективно удалять входные переменные из модели, обеспечивая тип автоматического выбора признаков. В этом руководстве вы узнаете, как разрабатывать и оценивать модели регрессии лассо в Python. После прохождения этого руководства вы будете знать: Приступим. Как разрабатывать модели регрессии LASSO в Python Это руководство разделено на три части; их: Линейная регрессия относится к модели, которая предполагает линейную связь между входными переменными и целевой переменной.2 Проблема с линейной регрессией заключается в том, что оценочные коэффициенты модели могут стать большими, что делает модель чувствительной к входным данным и, возможно, нестабильной. Это особенно верно для задач с небольшим количеством наблюдений ( выборок, ) или меньшим количеством выборок ( n ), чем входные предикторы ( p ) или переменные (так называемые задачи p >> n ). Один из подходов к обеспечению стабильности регрессионных моделей состоит в том, чтобы изменить функцию потерь, чтобы включить дополнительные затраты для модели с большими коэффициентами.Модели линейной регрессии, которые используют эти модифицированные функции потерь во время обучения, в совокупности называются линейной регрессией со штрафными санкциями. Популярным наказанием является наказание модели на основе суммы абсолютных значений коэффициентов. Это называется штрафом L1. Штраф L1 минимизирует размер всех коэффициентов и позволяет минимизировать некоторые коэффициенты до нулевого значения, что удаляет предсказатель из модели. Штраф L1 минимизирует размер всех коэффициентов и позволяет любому коэффициенту перейти к нулевому значению, эффективно удаляя входные характеристики из модели. Действует как тип автоматического выбора функции. … Следствием ограничения абсолютных значений является то, что некоторые параметры фактически установлены в 0 для некоторого значения лямбда. Таким образом, лассо дает модели, которые одновременно используют регуляризацию для улучшения модели и выбора признаков. — стр. 125, Прикладное прогнозное моделирование, 2013 г. Этот штраф может быть добавлен к функции стоимости для линейной регрессии и называется регуляризацией оператора наименьшего абсолютного сжатия и выбора (LASSO), или, чаще, « Lasso » (с заглавным регистром) для краткости. Популярной альтернативой регрессии гребня является модель оператора наименьшего абсолютного сжатия и выбора, часто называемая лассо. — стр. 124, Прикладное прогнозное моделирование, 2013 г. Используется гиперпараметр, называемый « лямбда, », который управляет взвешиванием штрафа для функции потерь. Значение по умолчанию 1.0 даст полный вес штрафа; значение 0 исключает штраф. Часто встречаются очень маленькие значения лямбда , например 1e-3 или меньше. Теперь, когда мы знакомы со штрафной регрессией Лассо, давайте посмотрим на рабочий пример. В этом разделе мы продемонстрируем, как использовать алгоритм регрессии лассо. Во-первых, давайте представим стандартный набор данных регрессии. Мы будем использовать набор данных о жилье. Набор данных корпуса — это стандартный набор данных машинного обучения, содержащий 506 строк данных с 13 числовыми входными переменными и числовой целевой переменной. Используя тестовую систему многократной стратифицированной 10-кратной перекрестной проверки с тремя повторами, наивная модель может достичь средней абсолютной ошибки (MAE) около 6,6. Лучшая модель может достичь MAE на том же самом тестовом жгуте около 1,9. Это обеспечивает границы ожидаемой производительности для этого набора данных. Набор данных включает прогнозирование стоимости дома с учетом деталей пригорода американского города Бостон. Нет необходимости загружать набор данных; мы загрузим его автоматически как часть наших проработанных примеров. В приведенном ниже примере загружается и загружается набор данных как Pandas DataFrame, а также суммируется форма набора данных и первых пяти строк данных. # загружаем и резюмируем набор данных о жилье

из панд импортировать read_csv

из matplotlib import pyplot

# загрузить набор данных

url = ‘https://raw.githubusercontent.com/jbrownlee/Datasets/master/housing.csv’

dataframe = read_csv (url, header = None)

# суммировать фигуру

печать (dataframe.shape)

# подвести итоги первых нескольких строк

печать (dataframe.голова ()) # загрузить и суммировать набор данных жилья из pandas import read_csv из matplotlib import pyplot # load dataset url = ‘https://raw.githubusercontent.com/jbrownlee/Datasets/master ‘ dataframe = read_csv (url, header = None) # суммировать фигуру print (dataframe.shape) # суммировать первые несколько строк print (dataframe.голова ()) При выполнении примера подтверждаются 506 строк данных, 13 входных переменных и одна числовая целевая переменная (всего 14). Мы также можем видеть, что все входные переменные являются числовыми. (506, 14)

0 1 2 3 4 5 … 8 9 10 11 12 13

0 0,00632 18,0 2,31 0 0,538 6,575 … 1 296,0 15,3 396,90 4,98 24,0

1 0,02731 0,0 7,07 0 0,469 6,421 … 2 242.0 17,8 396,90 9,14 21,6

2 0,02729 0,0 7,07 0 0,469 7,185 … 2242,0 17,8 392,83 4,03 34,7

3 0,03237 0,0 2,18 0 0,458 6,998 … 3 222,0 18,7 394,63 2,94 33,4

4 0,06905 0,0 2,18 0 0,458 7,147 … 3 222,0 18,7 396,90 5,33 36,2 [5 строк x 14 столбцов] (506, 14) 0 1 2 3 4 5 … 8 9 10 11 12 13 0 0.00632 18,0 2,31 0 0,538 6,575 … 1296,0 15,3 396,90 4,98 24,0 1 0,02731 0,0 7,07 0 0,469 6,421 … 2 242,0 17,8 396,90 9,14 21,6 2 0,02729 0,0 7,07 0 0,469 7,185 … 2 242,0 17,8 392,83 4,03 34,7 3 0,03237 0,0 2,18 0 0,458 6,998 … 3 222,0 18,7 394,63 2,94 33,4 4 0,06905 0,0 2,18 0 0,458 7,147 … 3 222,0 18,7 396,90 5,33 36,2 [5 строк x 14 столбцов] Библиотека машинного обучения Python scikit-learn предоставляет реализацию алгоритма штрафной регрессии Лассо через класс Лассо. Как ни странно, лямбда-член можно настроить с помощью аргумента « alpha » при определении класса. Значение по умолчанию — 1.0 или полный штраф. …

# определить модель

model = Lasso (альфа = 1.0) … # определить модель model = Lasso (alpha = 1.0) Мы можем оценить модель регрессии Лассо для набора данных о жилищном строительстве, используя повторную 10-кратную перекрестную проверку, и сообщить о средней средней абсолютной ошибке (MAE) для набора данных. # оценить модель регрессии лассо на наборе данных

из среднего значения импорта

из numpy import std

из абсолютного импорта

из панд импортировать read_csv

из sklearn.model_selection импорт cross_val_score

из sklearn.model_selection import RepeatedKFold

из sklearn.linear_model import Lasso

# загрузить набор данных

url = ‘https://raw.githubusercontent.com/jbrownlee/Datasets/master/housing.csv’

dataframe = read_csv (url, header = None)

данные = фрейм данных.ценности

X, y = данные [:,: -1], данные [:, -1]

# определить модель

модель = Лассо (альфа = 1,0)

# определить метод оценки модели

cv = RepeatedKFold (n_splits = 10, n_repeats = 3, random_state = 1)

# оценить модель

scores = cross_val_score (модель, X, y, scoring = ‘neg_mean_absolute_error’, cv = cv, n_jobs = -1)

# заставить оценки быть положительными

баллы = абсолютные (баллы)

print (‘Среднее значение MAE:% .3f (% .3f)’% (среднее (баллы), стандартное (баллы))) 1 2 3 4 5 6 7 8 9 10 11 12 13 140008 14 18 19 20 21 22 # оценить модель регрессии лассо в наборе данных из numpy import mean из numpy import std из numpy import absolute из pandas import read_csv from sklearn.model_selection import cross_val_score from sklearn.model_selection import RepeatedKFold from sklearn.linear_model import Lasso # загрузить набор данных url = ‘https://raw.githubusercontent.com/jbrownlee/Dat dataframe = read_csv (url, header = None) data = dataframe.values X, y = data [:,: -1], data [:, -1] # определить модель model = Lasso (alpha = 1.0) # определить метод оценки модели cv = RepeatedKFold (n_splits = 10, n_repeats = 3, random_state = 1) # оценить модель scores = cross_val_score (model, X, y, scoring = ‘neg_mean_absolute_error’, cv = cv, n_jobs = -1) # принудительно установить положительные значения баллов = абсолютные (баллы) print (‘Среднее значение MAE:%.3f (% .3f) ‘% (среднее (баллы), стандартное (баллы))) При выполнении примера оценивается алгоритм регрессии лассо для набора данных о жилищном строительстве и отображается средняя MAE для трех повторов 10-кратной перекрестной проверки. Ваши конкретные результаты могут отличаться из-за стохастической природы алгоритма обучения. Попробуйте запустить пример несколько раз. В этом случае мы видим, что модель достигла MAE около 3,711. Мы можем решить использовать регрессию Лассо в качестве нашей окончательной модели и делать прогнозы на новых данных. Этого можно достичь, подогнав модель ко всем доступным данным и вызвав функцию pred () , передав новую строку данных. Мы можем продемонстрировать это на полном примере, приведенном ниже. # сделать прогноз с помощью модели регрессии лассо для набора данных

из панд импортировать read_csv

из sklearn.linear_model import Lasso

# загрузить набор данных

url = ‘https://raw.githubusercontent.com/jbrownlee/Datasets/master/housing.csv ‘

dataframe = read_csv (url, header = None)

data = dataframe.values

X, y = данные [:,: -1], данные [:, -1]

# определить модель

модель = Лассо (альфа = 1,0)

# подходящая модель

model.fit (X, y)

# определить новые данные

строка = [0.00632,18.00,2.310,0,0.5380,6.5750,65.20,4.0900,1,296.0,15.30,396.90,4.98]

# сделать прогноз

yhat = model.predict ([строка])

# подвести итог прогнозу

print (‘Прогноз:% .3f’% yhat) 1 2 3 4 5 6 7 8 9 10 11 12 13 140008 14 18 # сделать прогноз с регрессионной моделью лассо для набора данных из pandas import read_csv из sklearn.linear_model import Lasso # загрузить набор данных url = ‘https://raw.githubusercontent.com/jbrownlee/Datasets/master/housing.csv’ dataframe = read_csv (url, header = None) data = dataframe.values X, y = data [:,: -1], data [:, -1] # определить модель model = Lasso (alpha = 1.0) # fit model model.fit (X, y) # определить новые данные row = [0.00632,18.00,2.310,0,0.5380,6.5750,65.20,4.0900,1,296.0,15.30,396.90,4.98] # сделать прогноз yhat = model.predict ([row]) # суммировать прогноз print (‘Прогноз:% .3f’% yhat) Выполнение примера соответствует модели и делает прогноз для новых строк данных. Ваши конкретные результаты могут отличаться из-за стохастической природы алгоритма обучения. Попробуйте запустить пример несколько раз. Далее мы можем посмотреть настройку гиперпараметров модели. Как мы узнаем, что гиперпараметр по умолчанию alpha = 1.0 подходит для нашего набора данных? Нет. Вместо этого рекомендуется протестировать набор различных конфигураций и выяснить, что лучше всего подходит для нашего набора данных. Один из подходов состоит в том, чтобы выполнить поиск alpha значений в диапазоне от 1e-5 до 100 по шкале log-10 и определить, что лучше всего подходит для набора данных. Другой подход — проверить значения между 0.0 и 1,0 с шагом сетки 0,01. В этом случае мы попробуем последнее. Пример ниже демонстрирует это с использованием класса GridSearchCV с сеткой значений, которые мы определили. # гиперпараметры поиска по сетке для регрессии лассо

из numpy import arange

из панд импортировать read_csv

из sklearn.model_selection import GridSearchCV

из sklearn.model_selection import RepeatedKFold

из sklearn.linear_model import Lasso

# загрузить набор данных

url = ‘https: // raw.githubusercontent.com/jbrownlee/Datasets/master/housing.csv ‘

dataframe = read_csv (url, header = None)

data = dataframe.values

X, y = данные [:,: -1], данные [:, -1]

# определить модель

model = Лассо ()

# определить метод оценки модели

cv = RepeatedKFold (n_splits = 10, n_repeats = 3, random_state = 1)

# определить сетку

сетка = dict ()

сетка [‘альфа’] = диапазон (0, 1, 0,01)

# определить поиск

search = GridSearchCV (модель, сетка, оценка = ‘neg_mean_absolute_error’, cv = cv, n_jobs = -1)

# выполнить поиск

результаты = поиск.подходят (X, y)

# суммировать

print (‘MAE:% .3f’% results.best_score_)

print (‘Конфигурация:% s’% results.best_params_) 1 2 3 4 5 6 7 8 9 10 11 12 13 140008 14 18 19 20 21 22 23 24 25 # гиперпараметры поиска сетки для регрессии лассо из numpy import arange from pandas import read_csv from sklearn.model_selection import GridSearchCV из sklearn.model_selection import RepeatedKFold из sklearn.linear_model import Lasso # загрузить набор данных url = ‘https://raw.githubusercontent.com/jbrownlee/Dat/jbrownlee/ dataframe = read_csv (url, header = None) data = dataframe.values X, y = data [:,: -1], data [:, -1] # определить модель model = Lasso () # определить метод оценки модели cv = RepeatedKFold (n_splits = 10, n_repeats = 3, random_state = 1) # определить сетку grid = dict () grid [‘alpha’] = arange (0, 1, 0.01) # определить поиск search = GridSearchCV (model, grid, scoring = ‘neg_mean_absolute_error’, cv = cv, n_jobs = -1) # выполнить поиск results = search.fit (X, y) # summarize print (‘MAE:% .3f’% results.best_score_) print (‘Config:% s’% results.best_params_) При выполнении примера каждая комбинация конфигураций будет оцениваться с использованием повторной перекрестной проверки. Ваши конкретные результаты могут отличаться из-за стохастической природы алгоритма обучения.Попробуйте запустить пример несколько раз. Вы можете увидеть некоторые предупреждения, которые можно игнорировать, например: Объективные не совпадали. Возможно, вы захотите увеличить количество итераций. Цель не сходилась. Возможно, вы захотите увеличить количество итераций. В этом случае мы видим, что мы достигли несколько лучших результатов, чем значение по умолчанию 3.379 против 3,711. Не обращайте внимания на знак; библиотека делает MAE отрицательным в целях оптимизации. Мы видим, что модель присвоила штрафу вес alpha , равный 0,01. MAE: -3,379

Конфигурация: {‘alpha’: 0.01} MAE: -3,379 Конфигурация: {‘alpha’: 0,01} Библиотека scikit-learn также предоставляет встроенную версию алгоритма, который автоматически находит хорошие гиперпараметры через класс LassoCV. Для использования класса модель соответствует набору обучающих данных, как обычно, а гиперпараметры настраиваются автоматически в процессе обучения. Затем подходящую модель можно использовать для прогнозирования. По умолчанию модель будет тестировать 100 значений alpha . Мы можем изменить это на сетку значений от 0 до 1 с разделением 0,01, как мы это делали в предыдущем примере, установив аргумент « alphas ». Пример ниже демонстрирует это. # использовать автоматически настроенный алгоритм регрессии лассо

из numpy import arange

из панд импортировать read_csv

из sklearn.linear_model импорт LassoCV

из sklearn.model_selection import RepeatedKFold

# загрузить набор данных

url = ‘https://raw.githubusercontent.com/jbrownlee/Datasets/master/housing.csv’

dataframe = read_csv (url, header = None)

data = dataframe.values

X, y = данные [:,: -1], данные [:, -1]

# определить метод оценки модели

cv = RepeatedKFold (n_splits = 10, n_repeats = 3, random_state = 1)

# определить модель

model = LassoCV (alphas = arange (0, 1, 0.01), cv = cv, n_jobs = -1)

# подходящая модель

model.fit (X, y)

# подвести итоги выбранной конфигурации

print (‘альфа:% f’% model.alpha_) 1 2 3 4 5 6 7 8 9 10 11 12 13 140008 14 18 # use автоматически настроенный алгоритм регрессии лассо из numpy import arange from pandas import read_csv from sklearn.linear_model import LassoCV from sklearn.model_selection import RepeatedKFold # загружаем набор данных url = ‘https://raw.githubusercontent.com/jbrownlee/Datasets/master/housing.csv’ data = dataframe.values X, y = data [:,: -1], data [:, -1] # определить метод оценки модели cv = RepeatedKFold (n_splits = 10, n_repeats = 3, random_state = 1) # определить модель model = LassoCV (alphas = arange (0, 1, 0.01), cv = cv, n_jobs = -1) # fit model model.fit (X, y) # суммировать выбранную конфигурацию print (‘alpha:% f’% model.alpha_) Выполнение примера соответствует модели и обнаруживает гиперпараметры, которые дают наилучшие результаты, с помощью перекрестной проверки. Ваши конкретные результаты могут отличаться из-за стохастической природы алгоритма обучения. Попробуйте запустить пример несколько раз. В этом случае мы видим, что модель выбрала гиперпараметр альфа = 0.0. Это отличается от того, что мы нашли с помощью ручного поиска по сетке, возможно, из-за систематического способа поиска или выбора конфигураций. В этом разделе представлены дополнительные ресурсы по теме, если вы хотите углубиться. В этом руководстве вы узнали, как разрабатывать и оценивать модели регрессии лассо в Python. В частности, вы выучили: Есть вопросы? … всего несколько строк кода scikit-learn Узнайте, как это сделать, в моей новой электронной книге: Охватывает самоучителей и сквозных проектов , например: Пропустить академики. Только результаты. Целью регрессии лассо и гребня является уменьшение чрезмерной подгонки. По сути, мы можем разбить наши точки данных на два компонента: шаблон + стохастический шум Например, если вы моделируете что-то об общем состоянии здоровья населения, но обследуете пациентов только в залах ожидания врачей.Эта систематическая ошибка (многократный опрос больных) приведет к совершенно неверной статистике. Разница в здоровье — это шум. В качестве другого примера рассмотрим вождение. Учитывая кривую с определенной кривизной, существует оптимальное направление рулевого управления и оптимальная скорость. Когда вы наблюдаете на этой кривой 100 водителей, большинство из них будут близки к оптимальному углу поворота и скорости. Но у них не будет точно такого же угла поворота и скорости. Таким образом, кривизна дороги влияет на изменение угла поворота и скорости, а затем возникает шум, вызывающий отклонения от этого оптимального значения. Теперь цель машинного обучения — смоделировать шаблон и игнорировать шум. Каждый раз, когда алгоритм пытается подогнать шум в дополнение к шаблону, он переоценивает. Линейные модели — это один из простейших способов прогнозирования выходных данных с использованием линейной функции входных характеристик. Ниже мы показали линейную модель, основанную на количестве n характеристик: В приведенном выше уравнении w [0], w [1] и т. Д. — значения коэффициентов, а b — точка пересечения.Линейная регрессия ищет оптимизацию w и b таким образом, чтобы минимизировать функцию стоимости. Функцию стоимости для вышеуказанной модели можно записать как: После того, как мы используем линейную регрессию для набора данных, разделив его на набор для обучения и тестирования, вычислив его оценки на наборе для обучения и тестирования, мы получим приблизительное представление о том, страдает ли наша модель от переоборудования или от недостатка. Недостаточная подгонка возникает, когда модель слишком проста — содержит слишком мало функций или слишком упорядочена, — что делает ее негибкой в обучении на основе набора данных.С другой стороны, если у нас большое количество функций и результат теста относительно низок, чем результат обучения, то это проблема чрезмерного обобщения или чрезмерной подгонки. Лассо и регрессия Риджа — это некоторые из методов, позволяющих снизить сложность модели и предотвратить чрезмерную подгонку за счет ограничения коэффициентов предикторов, которые могут существовать из-за простой линейной модели. Риджерная регрессия В регрессии Риджа функция стоимости линейной регрессии изменяется путем добавления штрафного члена, эквивалентного квадрату величины коэффициентов, как показано на изображении ниже: Наша основная цель здесь — минимизировать функцию затрат в уравнении 1.2. Риджевая регрессия накладывает ограничение на коэффициенты (w). Штрафной член (λ) упорядочивает коэффициенты так, что, если они принимают большие значения, он сжимает их, штрафуя функцию оптимизации. За счет уменьшения коэффициентов регрессия Риджа снижает сложность модели и многоколлинеарность. В уравнении 1.3 выше, если λ → 0, функция стоимости становится аналогичной линейной регрессии, потому что штрафной член в приведенном выше уравнении становится равным нулю. Поясним это с помощью изображения: Давайте разберемся с рисунком выше.Ось , ось X, здесь — это индекс коэффициента , , который представляет 13 предикторов, доступных в наборе данных, а ось , ось Y, — это величина коэффициента для всех этих переменных-предикторов. При низком значении α (0,01), когда коэффициенты менее ограничены, величины коэффициентов для всех переменных почти соответствуют линейной регрессии. Для более высокого значения α (100) мы можем видеть выше, что значения величины коэффициентов для многих переменных значительно меньше по сравнению с линейной регрессией.Это доказывает, что гребенчатая регрессия уменьшает величину коэффициента для разных значений α. Регрессия Лассо Функция стоимости для регрессии Лассо может быть записана как: То же, что и регрессия Риджа в функции стоимости, если значение λ = 0, приведенное выше уравнение сводится к линейная регрессия. Здесь разница между регрессией Лассо и Ридж заключается в том, что вместо квадрата коэффициентов учитываются величины. Лассо-регрессия может уменьшить значения коэффициентов предикторов до нуля, т. Е. Некоторые функции полностью удаляются из модели, что помогает уменьшить чрезмерную подгонку в модели, а также помогает при выборе функций. Поясним это с помощью изображения: Давайте разберемся с рисунком выше. Как регрессия Лассо и Ридж делает выбор объектов? Давайте объясним, как регрессия лассо и гребня делает выбор элементов: Lasso, Ridge и ElasticNet являются частью семейства линейной регрессии, где предполагается, что x (вход) и y (выход) имеют линейную зависимость. В sklearn LinearRegression относится к самому обычному методу линейной регрессии по методу наименьших квадратов без регуляризации (штраф за веса).Основное различие между ними заключается в том, штрафуется ли модель за ее вес. В оставшейся части поста я расскажу о них в контексте библиотеки scikit-learn. Линейная регрессия (в scikit-learn) — это самая основная форма, в которой модель вообще не наказывается за выбор весов. Это означает, что на этапе обучения, если модель чувствует, что одна конкретная функция особенно важна, модель может придавать ей большое значение. Иногда это приводит к переобучению небольших наборов данных.Следовательно, изобретены следующие методы. Lasso — это модификация линейной регрессии, при которой модель штрафуется на сумму абсолютных значений весов. Таким образом, абсолютные значения веса будут (в общем) уменьшены, и многие из них будут стремиться к нулю. Во время обучения целевая функция принимает вид: Как видите, Лассо ввел новый гиперпараметр, альфа, , коэффициент для штрафов за веса. Ridge делает шаг вперед и штрафует модель на сумму квадратов значений весов.Таким образом, веса не только имеют меньшие абсолютные значения, но также имеют тенденцию штрафовать крайние значения весов, в результате чего группа весов распределяется более равномерно. Целевая функция принимает следующий вид: ElasticNet представляет собой гибрид Lasso и Ridge, в который включены как штрафы по абсолютному значению, так и штрафы в квадрате, регулируемые другим коэффициентом l1_ratio: Масштабированы ли ваши данные? Как видно из приведенных выше уравнений, штрафные веса суммируются в функции потерь.Предположим, у нас есть функция house_size в диапазоне 2000, а другая функция num_bedrooms в диапазоне 3, тогда мы ожидаем, что вес для house_size может быть естественно меньше веса для num_bedrooms . В таком случае одинаковое наказание за вес каждой функции становится неуместным. Следовательно, важно масштабировать или нормализовать данные перед их вводом в модели. Небольшое примечание, по умолчанию в sklearn для этой модели для параметра «normalize» установлено значение false. Вы можете либо включить «нормализацию», либо использовать ScandardScaler для масштабирования данных. {p} | \ beta_ {j} | \).p | \ hat {\ beta} _ {LS, j} | \) обозначают абсолютный размер оценок методом наименьших квадратов. Значения \ (0

{p} | \ beta_ {j} | \).p | \ hat {\ beta} _ {LS, j} | \) обозначают абсолютный размер оценок методом наименьших квадратов. Значения \ (0 Геометрическая интерпретация

Следовательно, лассо выполняет сжатие и (эффективно) выбор подмножества.

Следовательно, лассо выполняет сжатие и (эффективно) выбор подмножества. Вывод для оценки лассо

\ begin {уравнение *}

\ pi (\ beta) = \ frac {\ lambda} {2} \ exp (- \ lambda | \ beta_j |)

\ end {Equation *}

Байесовские оценки лассо (апостериорные медианы) кажутся компромиссом между обычным лассо и регрессией гребня.2}})

\ end {уравнение *} Сравните регрессию гребня и лассо

(Ось x фактически показывает долю усадки, а не \ (\ lambda \)).

(Ось x фактически показывает долю усадки, а не \ (\ lambda \)). Групповое лассо

Регрессия ЛАССО: полное понимание (2021 г.)

Введение  Но есть и другие типы регрессии, которые имеют значение. Регрессия лассо, регрессия гребня, полиномиальная регрессия, пошаговая регрессия и эластичная чистая регрессия — это другие типы регрессий. В этом блоге мы сосредоточимся на регрессии Лассо. Возрастающие полиномы в уравнении, составленном для регрессионных моделей, приводят к переобучению.Чтобы справиться с переобучением, используются методы регуляризации.

Но есть и другие типы регрессии, которые имеют значение. Регрессия лассо, регрессия гребня, полиномиальная регрессия, пошаговая регрессия и эластичная чистая регрессия — это другие типы регрессий. В этом блоге мы сосредоточимся на регрессии Лассо. Возрастающие полиномы в уравнении, составленном для регрессионных моделей, приводят к переобучению.Чтобы справиться с переобучением, используются методы регуляризации. 1.

Понимание регрессии Лассо

2.

Что такое регуляризация? 3.

Методы регуляризации  Методы аналогичны, за исключением штрафа, поскольку регрессия лассо использует абсолютные веса, тогда как регрессия гребня использует квадрат весов.

Методы аналогичны, за исключением штрафа, поскольку регрессия лассо использует абсолютные веса, тогда как регрессия гребня использует квадрат весов. 4.

Что такое регрессия ЛАССО?

5.

Регрессия Лассо В / с Регрессия гребня  Эта величина смещения известна как штраф за регрессию гребня. Добавление штрафа приводит к изменению функции затрат.

Эта величина смещения известна как штраф за регрессию гребня. Добавление штрафа приводит к изменению функции затрат. Успех этих методов во многом зависит от доступности данных для машинного обучения. Регрессия гребня эффективна по сравнению с лассо, но лассо успешно устраняет нежелательные параметры, присутствующие в модели.

Успех этих методов во многом зависит от доступности данных для машинного обучения. Регрессия гребня эффективна по сравнению с лассо, но лассо успешно устраняет нежелательные параметры, присутствующие в модели. Вас интересует ИИ и машинное обучение? Если вы хотите окунуться в мир новых технологий, вы можете ускорить свою карьеру с курсами Machine Learning And AI Courses от Jigsaw Academy.

Вас интересует ИИ и машинное обучение? Если вы хотите окунуться в мир новых технологий, вы можете ускорить свою карьеру с курсами Machine Learning And AI Courses от Jigsaw Academy. ТАКЖЕ ПРОЧИТАЙТЕ

Регрессия хребта и лассо: регуляризация L1 и L2 | Сапташва Бхаттачарья

Так же, как регрессия Риджа, параметром регуляризации (лямбда) можно управлять, и мы увидим эффект ниже, используя набор данных рака в

sklearn .Причина, по которой я использую данные о раке вместо данных из Бостонских домов, которые я использовал раньше, заключается в том, что набор данных по раку содержит 30 функций по сравнению с только 13 характеристиками данных из Бостонских домов. Таким образом, выбор признаков с использованием регрессии Лассо можно хорошо отобразить, изменив параметр регуляризации. import math

import matplotlib.pyplot as plt

import pandas as pd

import numpy as np # разница в регрессии лассо и гребня состоит в том, что некоторые из коэффициентов могут быть нулевыми, т.е. некоторые из функций

# полностью игнорируются из sklearn. linear_model import Lasso

linear_model import Lasso

from sklearn.linear_model import LinearRegression

из sklearn.datasets import load_breast_cancer

from sklearn.cross_validation import train_test_splitcancer = load_breast_cancer ()

#print Cance.keys () раку_df = pd.DataFrame (рак.data, columns = Cance.feature_names) #print Cance_df.head (3) X = Cance.data

Y = Cance.targetX_train, X_test, y_train, y_test = train_test_split (X, Y, test_size = 0.3, random_state = 31) lasso = Lasso ()

lasso.fit (X_train, y_train)

train_score = lasso.score (X_train, y_train)

test_score = lasso.score (X_test, y_test)

coeff_used = np.sum (lasso.coef _! = 0) print " оценка обучения: ", train_score

print" test score: ", test_score

print" количество использованных функций: ", coeff_usedlasso001 = Lasso (alpha = 0.01, max_iter = 10e5)

lasso001.fit (X_train, y_train) train_score001 = lasso001.score (X_train, y_train)

test_score001 = lasso001.score (X_test, y_test)

coeff_used001 = np. sumco (lasso = 0 print "оценка обучения для альфа = 0,01:", train_score001

sumco (lasso = 0 print "оценка обучения для альфа = 0,01:", train_score001

print "оценка теста для альфа = 0,01:", test_score001

print "количество используемых функций: для альфа = 0,01:", coeff_used001lasso00001 = Lasso (alpha = 0,0001, max_iter = 10e5)

lasso00001.fit (X_train, y_train) train_score00001 = lasso00001.score (X_train, y_train)

test_score00001 = lasso00001.score (X_test, y_test)